Erik J. Larson: “Un uso nefasto de la IA plantea problemas graves como se ha visto en la guerra de Ucrania”

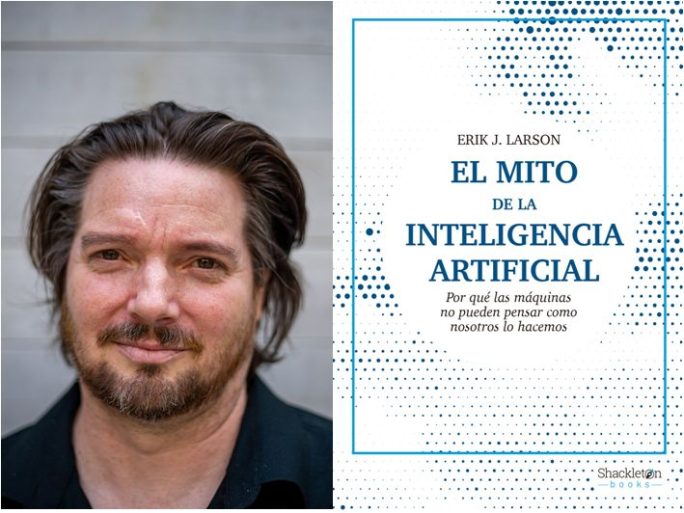

En su libro ‘El mito de la inteligencia artificial’, el científico e investigador hace un recorrido por el panorama actual para demostrar lo lejos que se está de llegar a la superinteligencia

Por Lara Gomez Ruiz

Un mundo en el que las máquinas superen en inteligencia a la raza humana. Esta bien podría ser la trama de una novela de ciencia ficción o de un guion de Hollywood pero cada vez son más los expertos que auguran este futuro. El científico experto en computación Erik J. Larson se lleva las manos a la cabeza cuando escucha determinadas afirmaciones, tal y como él mismo reconoce a La Vanguardia. Por ello, decidió poner los puntos sobre las íes y escribir El mito de la inteligencia artificial (Shackleton Books) para argumentar por qué las máquinas no pueden pensar como nosotros lo hacemos.

“A corto o medio plazo desde luego que no podrán hacerlo. Soy muy escéptico con aquellos que dicen que la Inteligencia Artificial logrará una comprensión real, como lo hacen las mentes humanas. ¿Será algún día posible? Por ahora es algo que desconocemos. A día de hoy no tenemos ni idea de cómo programar determinado aspectos y esa es la barrera más grande”, señala el experto. Se refiere a “un tipo de inferencia que llamamos abducción o generación de hipótesis y que ya formuló en el siglo XIX un científico adelantado a su tiempo: Charles Sanders Peirce. Nosotros como humanos es algo que hacemos constantemente pero no sabemos cómo proporcionarlo a las máquinas todavía. Hasta que esto suceda, no veremos el eclipse de la IA ni igualaremos las mentes humanas”.

Todos estos temores infundados “son parte de la cultura de Silicon Valley desde hace décadas, pues a menudo tienen visiones futuristas de ciencia ficción de la tecnología. Pero no son ciertos. Lo que hacen en realidad los verdaderos programadores de IA es perfeccionar conjuntos de datos y modificar características y algoritmos para obtener los resultados correctos.»

En este sentido, reflexiona, «los medios y el público tienen la impresión de que estamos construyendo máquinas sobrehumanas que terminarán con nosotros pero en realidad estamos creando programas para realizar tareas limitadas como jugar a juegos o traducir idiomas. Nunca construimos sistemas que tengan sentido común o inteligencia general. Es más, es algo retorcido pensar que los chips de silicio pueden generar mentes humanas”.

Todos estos mitos preocupan a Larson ya que “destruyen la posibilidad de innovaciones reales. Crean una cultura de la inevitabilidad, donde básicamente los científicos se dicen a sí mismos y al público que estamos en este camino ineludible hacia la supremacía de la superinteligencia”.

Otra cuestión que inquieta al emprendedor es que “solo las empresas ricas como Google o Meta están haciendo IA. Antes, cualquier científico raso podía crear sistemas completos de IA. Ahora, eso solo está al alcance de las empresas ricas. Creo que esto también podría sofocar la innovación”.

Larson insiste en que los miedos de la Inteligencia Artificial deberían centrarse ahora en las “deep fakes, es decir, la información errónea generada por un bot inteligente. Este y otros usos nefastos de la IA sí que pueden plantear problemas graves para la humanidad. De hecho, ya estamos experimentándolos con la guerra cibernética entre naciones, particularmente con Rusia y la guerra en curso en Ucrania”.

Otro uso no tan peligroso pero con el que el autor no se muestra demasiado de acuerdo es con «todo aquel que hace que perdamos nuestra conexión con arte, estilo y creatividad, ya que es parte de lo que nos hace humanos. No me gustaría por ejemplo leer un libro escrito por una máquina. Puede que el texto sea legible pero no va a tener sentimiento detrás. Prefiero mil veces las historias escritas por novelistas. Y eso es algo de lo que dudo que vaya a cambiar mi opinión», concluye.

Publicado en La Vanguardia – 20/3/2023